Популярное о чистоте и уборке

Актуальные проблемы

- Чем убрать желтизну с пластиковых окон? Почему образуется и как отмыть окна от грязи? 8 способов вернуть первоначальную белизну

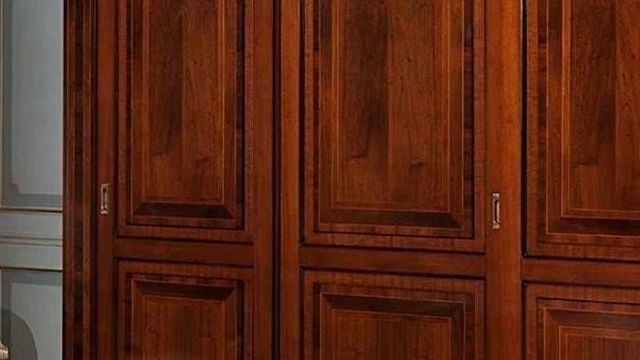

- Какие окна лучше ставить – деревянные или пластиковые?

- 8 народных рецептов, как почистить керамическую плиту от нагара в домашних условиях

- 6 способов решить проблему мигания светодиодных и энергосберегающих ламп

- Как почистить ковер в домашних условиях

Обновления на сайте